随着人工智能技术的飞速发展,以ChatGPT为代表的大型语言模型正深刻改变着网络空间的面貌。在网络安全与信息安全软件开发领域,这一变革尤为显著,既带来了前所未有的机遇,也引发了不容忽视的挑战。

一、ChatGPT在网络安全领域的积极赋能

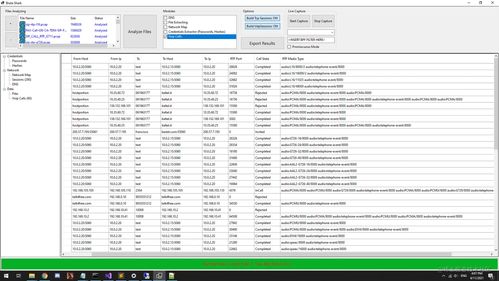

ChatGPT为网络安全防御能力的提升注入了强劲动力。在软件开发环节,它能够辅助安全工程师进行代码审计,通过自然语言指令快速识别潜在漏洞,如SQL注入、跨站脚本(XSS)等,并生成修复建议,显著提高安全编码的效率和准确性。在安全运营中心(SOC),ChatGPT可以解析海量日志和告警信息,自动生成事件分析报告,帮助分析师快速理解攻击模式,缩短响应时间。它还能用于模拟网络钓鱼攻击测试,生成更逼真的钓鱼邮件内容,以训练员工提升安全意识。

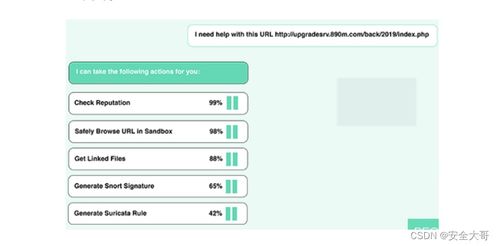

在信息安全软件开发中,ChatGPT的集成正催生新一代智能安全工具。例如,基于其API开发的应用程序可以实现智能化的威胁情报摘要、自动化渗透测试脚本生成,或是创建交互式安全培训助手。这些工具不仅降低了专业门槛,也使安全防护更加主动和个性化。

二、新型风险与安全挑战

ChatGPT的强大能力也被恶意行为者所觊觎,给网络安全带来了新的威胁维度。攻击者可以利用它高效生成恶意代码、构造复杂的社会工程学攻击剧本,或批量生产用于混淆安全检测的钓鱼信息。这降低了网络犯罪的技术门槛,使攻击更加规模化、智能化。例如,自动生成的钓鱼邮件在语法和逻辑上几乎与真实邮件无异,极大地增加了识别难度。

对于信息安全软件开发而言,集成ChatGPT等AI模型本身也引入了新的攻击面。模型可能遭受提示注入攻击,被诱导输出敏感信息或执行有害指令;训练数据中的偏见或漏洞也可能被利用。因此,开发过程必须融入全新的“AI安全”考量,确保模型本身的安全性、可靠性和可控性。

三、迈向安全与智能的融合未来

面对这一双刃剑,网络安全行业必须积极应对。一方面,应大力发展以AI对抗AI的防御技术,利用同类模型构建更智能的检测与响应系统。例如,训练专门的模型来识别AI生成的恶意内容。另一方面,在信息安全软件开发中,必须将安全设计(Security by Design)原则贯穿始终,对AI组件进行严格的安全测试与审计,并建立相应的伦理与使用规范。

政策与法规也需与时俱进。各国正在探索对生成式AI的监管框架,要求其开发与应用,特别是在关键信息基础设施领域,必须符合安全、透明和可问责的标准。行业内部则应加强协作,共享针对AI新型威胁的攻防知识。

结论

ChatGPT的兴起标志着网络安全进入了一个人机协同的新时代。它既不是纯粹的解药,也非单一的毒药。对于网络与信息安全软件开发而言,关键在于如何驾驭这股力量——通过技术创新将AI转化为坚固的盾牌,同时通过前瞻性的管理和规范,防范其被铸成锋利的矛。唯有在机遇与风险之间取得平衡,我们才能构建一个更智能、也更安全的数字未来。